NVIDIA: ¿Por qué es la empresa más grande del planeta?

De las GPUs para videojuegos a la infraestructura de la inteligencia artificial: qué vende NVIDIA y por qué el mercado lleva meses sin moverse

Lo más importante de esta semana: NVIDIA publica resultados mañana miércoles 25.

Así que hoy vamos a intentar entender qué vende exactamente y por qué el mercado está en vilo.

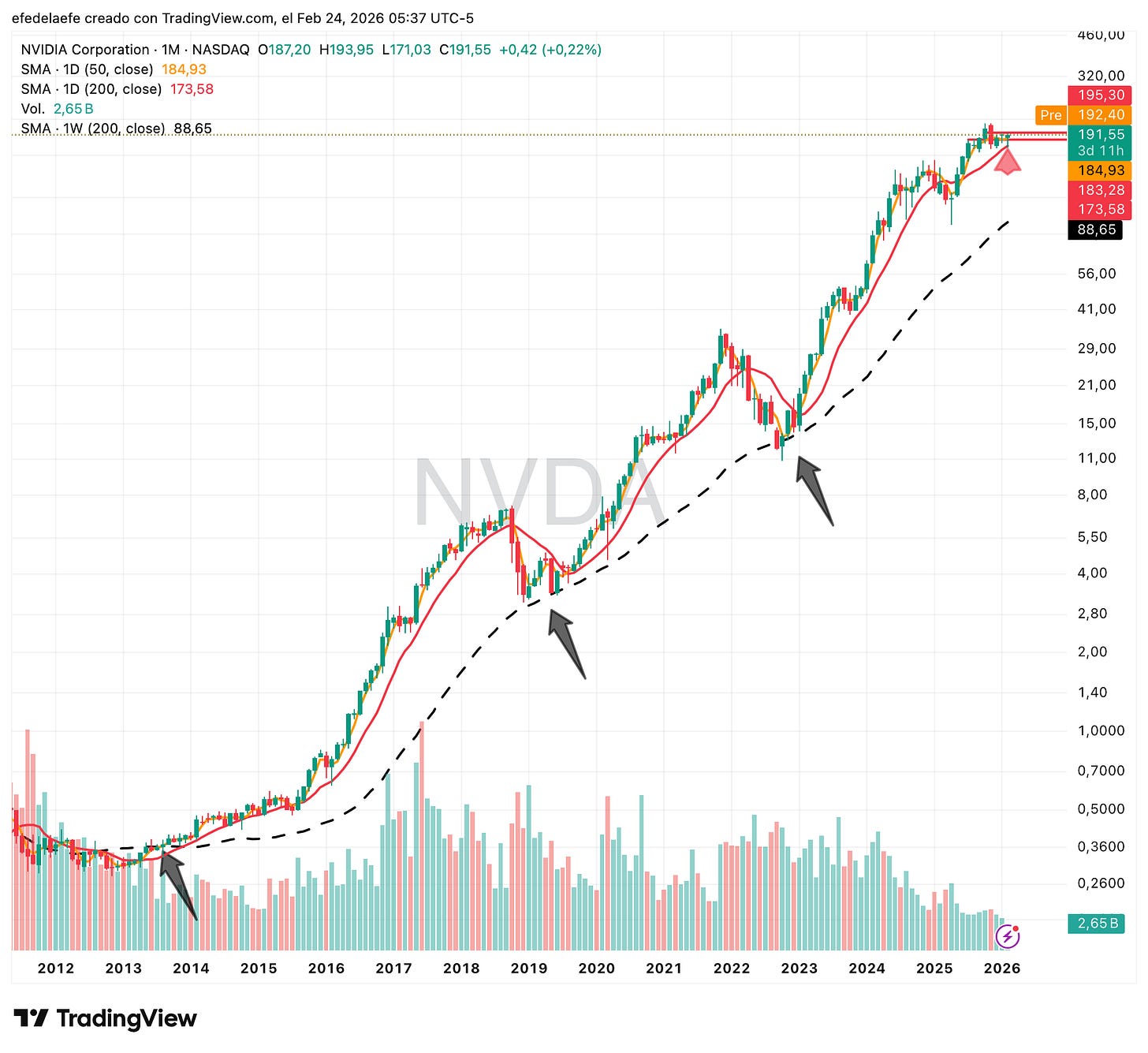

Lo primero de todo, el gráfico:

NVDA lleva estancada en torno a 186 desde julio

La media de 200 se está acercado al precio y actuando como soporte

Hay una resistencia en torno a 195 que ya ha intentado romper sin éxito

La presentación de resultados de mañana miércoles puede hacer que por fin salga del rango hacia arriba o hacia abajo, así que vamos a echarle un vistazo a ver qué es lo que vende para intentar entenderla mejor.

Y de paso, a entender por qué batir las expectativas no garantiza que la acción suba.

Primero, lo básico:

¿Qué es una GPU?

Tu ordenador tiene un procesador, la CPU (central processing unit), que es el cerebro del sistema. Hace pocas cosas pero muy rápido y de forma secuencial: una detrás de otra.

Pero tu ordenador también tiene una GPU. La GPU (graphics processing unit) fue diseñada originalmente para los videojuegos, donde necesitas calcular millones de píxeles a la vez. Es menos potente por operación individual, pero puede hacer millones de cálculos en paralelo simultáneamente.

NVIDIA lleva 20 años siendo el fabricante dominante de GPUs para videojuegos. Y de repente, en 2022, el mundo entero necesita millones de ellas para construir inteligencia artificial.

Pero NVIDIA ya lo había previsto mucho antes.

Todo empieza en 2012 (¿o no?)

En 2012, un investigador de la Universidad de Toronto llamado Alex Krizhevsky entrenó una red neuronal llamada AlexNet que arrasó en la competición de reconocimiento de imágenes ImageNet.

Ganó por un margen tan grande que el mundo del machine learning se quedó atónito.

¿Cómo lo hizo?

Usando dos GPUs de NVIDIA para entrenar el modelo. Ese paper fue el momento en que la comunidad científica entendió que las GPUs eran el hardware natural para el deep learning.

Jensen Huang, fundador y CEO de NVIDIA ya lo había previsto antes.

Todo empieza en 2006

En realidad, Jensen lo vio mucho antes. En 2006 sabía su hardware era objetivamente una máquina de cálculo paralelo masivo, y pensó que eso tenía valor más allá de los videojuegos.

Los científicos en universidades ya estaban intentando usar GPUs de NVIDIA para simulaciones físicas, dinámica de fluidos, cálculo financiero, bioinformática.

Lo hacían de forma muy torpe, escribiendo su código como si fuera código gráfico porque no había otra forma.

Jensen penso: "mi hardware es útil para más cosas de las que le estamos sacando partido, voy a hacer que sea más fácil de usar para cualquier tipo de cálculo".

El problema que CUDA resuelve

Como os digo, los científicos tenían que usar las GPUs de forma rudimentaria.

Una GPU tiene miles de núcleos pequeños diseñados para hacer cálculos en paralelo.

Pero originalmente esos núcleos solo “hablaban” el lenguaje de los gráficos: triángulos, píxeles, texturas.

Si eras un científico y querías usar esa potencia de cálculo para otra cosa, no podías:

No había forma de hablarle a la GPU en términos que no fueran gráficos.

¿Cómo lo resuelve NVIDIA?

Con CUDA.

CUDA es básicamente una extensión del lenguaje de programación C que permite a cualquier programador decirle a la GPU “ejecuta este cálculo” sin tener que hablar el idioma de los gráficos.

CUDA es una capa de software que traduce entre el mundo del programador y el hardware de la GPU.

Una analogía:

Imagina que tienes una fábrica con 10.000 operarios (los núcleos de la GPU) que hasta ahora solo sabían fabricar zapatos (gráficos).

CUDA es básicamente enseñarles a leer instrucciones genéricas, de forma que ahora puedes mandarles fabricar cualquier cosa: zapatos, coches, muebles.

La fábrica es la misma, los operarios son los mismos, pero ahora son infinitamente más versátiles.

CUDA es el verdadero moat de NVIDIA

Cuando un ingeniero de IA aprende a programar, aprende CUDA.

Cuando una universidad enseña deep learning, enseña con CUDA.

Cuando publicas un paper académico con código, el código está en CUDA.

Los frameworks más usados del mundo, PyTorch y TensorFlow, están construidos sobre CUDA y optimizados para CUDA durante años.

CUDA es el motivo por el que NVIDIA no es simplemente un fabricante de chips. Es el dueño del lenguaje en el que está escrita la inteligencia artificial moderna. Y eso vale mucho más que cualquier ventaja de hardware que un competidor pueda desarrollar.

La apuesta de Jensen en 2006 era mucho más modesta que lo que resultó ser. Era básicamente “los científicos e ingenieros deberían poder usar nuestras GPUs sin tener que aprender a programar gráficos”. Eso es todo.

Lo que nadie previó, ni el propio Jensen, es que en 2012 llegaría AlexNet y demostraría que las redes neuronales entrenadas con GPUs podían hacer cosas que parecían imposibles.

En ese momento NVIDIA ya llevaba 6 años construyendo el ecosistema CUDA, que era exactamente lo que la comunidad de machine learning necesitaba. Eso es lo que convirtió una apuesta modesta en una ventaja competitiva de 15 años.

Desde entonces el precio de la acción ha pasado de $0,35 a $192 con solo dos descansos en la media de 200 semanas y es actualmente la compañía más grande del mundo por capitalización de mercado (4.66 billones de USD) a fecha de hoy, 24 de febrero de 2026.

Vale pero, ¿Qué vende NVDA ahora?

NVIDIA no tiene un solo producto. Tiene generaciones de chips, cada una más potente que la anterior.

Igual que Apple vende un iPhone actual al que llama iPhone 17 pero sigue vendiendo también los iPhones de generaciones anteriores como el 15 o el 16, NVIDIA sigue vendiendo generaciones anteriores.

Estas son las generaciones que vas a escuchar en los resultados de mañana:

A100 — Arquitectura Ampere (2020)

La A100 es el abuelo del boom de la IA. Cuando explotó ChatGPT en 2022-2023, este era el chip que todo el mundo quería y nadie podía conseguir.

Precio: ~$10.000-15.000 por unidad (en mercado secundario, ya obsoleto).

Hoy es tecnología de hace seis años. Pero sigue siendo enormemente útil, especialmente para inferencia: ejecutar modelos que ya están entrenados. No necesitas lo último del mercado para que ChatGPT te responda una pregunta, necesitas muchos chips trabajando en paralelo, y el A100 sigue siendo perfectamente válido para eso.

H100 — Arquitectura Hopper (2022)

Este fue el chip que convirtió a NVIDIA en la empresa más valiosa del mundo. Tres veces más potente que el A100 para tareas de IA. Durante 2023 y 2024 tenía listas de espera de meses. Jensen Huang llegó a decir que era “el producto más popular en la historia de la compañía”.

Precio: ~$25.000-40.000 por unidad.

El H100 es el estándar actual para la mayoría de las aplicaciones de IA. Si una empresa mediana está construyendo su infraestructura de IA hoy, probablemente está usando H100.

B200 — Arquitectura Blackwell (2025)

La generación actual. El producto estrella de NVIDIA ahora mismo. Respecto al H100, dobla la potencia de cómputo para inferencia y mejora sustancialmente el entrenamiento, consumiendo menos energía por operación.

Pero lo más importante de Blackwell no es el chip individual. Es cómo se vende.

Aquí hay un cambio de modelo de negocio muy relevante que explica en parte por qué los márgenes de NVIDIA están mejorando:

Antes vendían chips individuales o servidores con 8 GPUs.

Ahora el producto estrella es el GB200 NVL72: un rack completo con 72 GPUs de Blackwell interconectadas que funcionan prácticamente como un solo sistema.

El precio de uno de estos racks ronda los 3 millones de dólares. Precio implicito: ~$40.000-50.000 por chip individual.

Los hyperscalers están comprando racks enteros,

miles de ellos.

Jensen Huang dijo en el último earnings que las ventas de Blackwell están “off the charts” y que los data centers están “sold out”.

Rubin — La siguiente generación (prevista H2 2026)

Rubin es la arquitectura que viene después de Blackwell. NVIDIA la ha anunciado pero los detalles técnicos completos no están públicos todavía.

¿Por qué importa para los resultados de mañana?

Porque el mercado tiene una pregunta concreta: ¿va a haber una pausa en los pedidos mientras los clientes esperan a Rubin?

Igual que cuando va a salir un iPhone nuevo muchos clientes esperan para no comprar el modelo anterior: cuando se anuncia una generación nueva, algunos clientes frenan los pedidos de la generación actual esperando lo siguiente.

¿Es real la demanda?

Hasta aquí hemos hablado de lo que NVIDIA vende. Pero ¿cómo sabemos que la demanda es real y no solo hype?

Existe un mercado que lo demuestra de forma muy directa:

El mercado de alquiler de GPUs

No todo el mundo que necesita GPUs las compra. Una startup que está desarrollando un modelo de IA no va a gastarse 3 millones en un rack de Blackwell. Un investigador universitario tampoco. Un desarrollador que quiere experimentar con un modelo grande, tampoco.

Para ellos existe el mercado de alquiler.

Los grandes proveedores cloud como AWS, Google Cloud o Microsoft Azure ofrecen este servicio. Y luego hay proveedores especializados como Lambda Labs, que es el equivalente más enfocado específicamente en IA.

El precio se mide en dólares por GPU por hora. Alquilas las GPUs que necesitas, las usas el tiempo que necesitas, y pagas por lo que consumes.

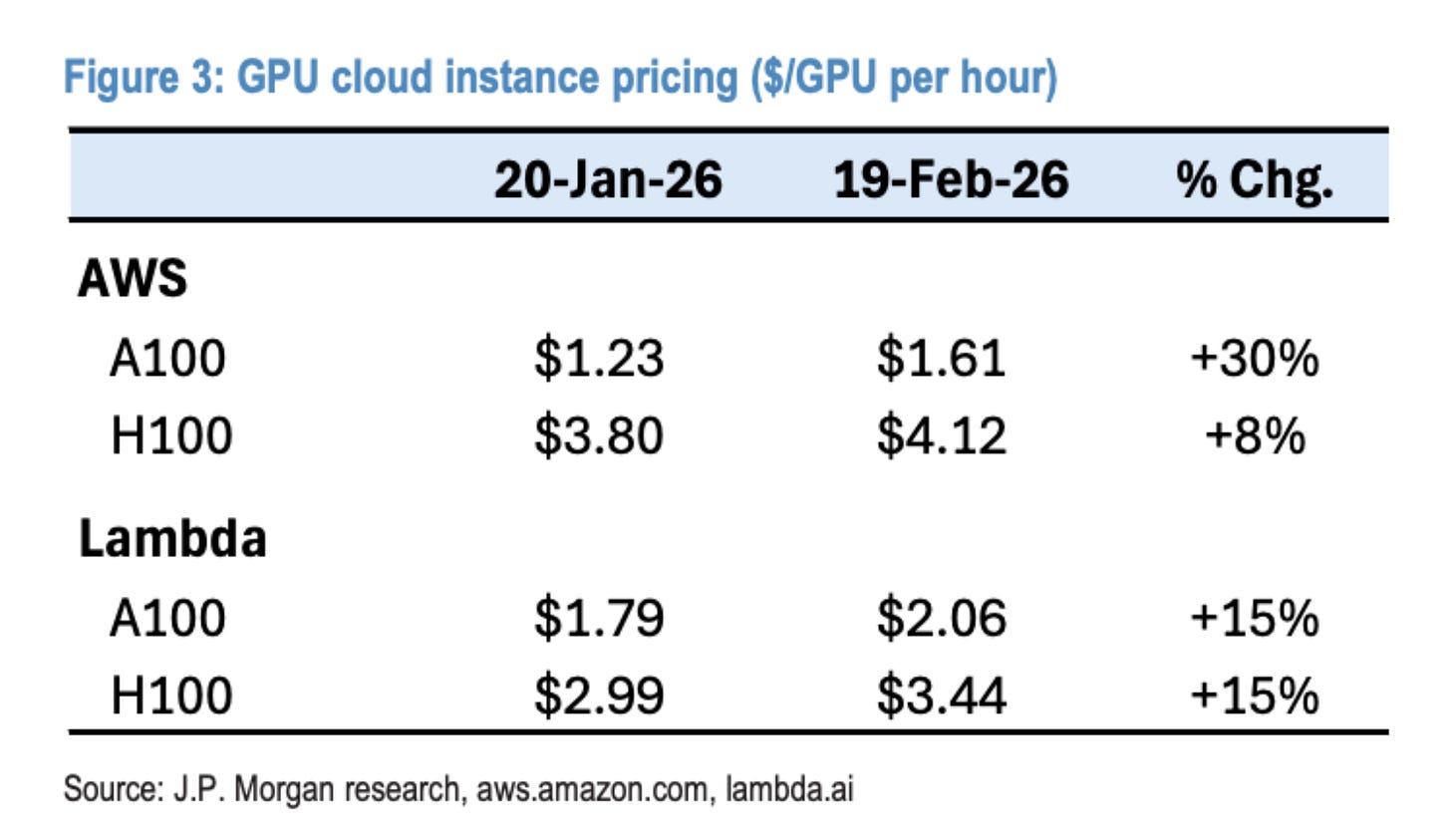

Los datos de JPMorgan del 19 de febrero, hace apenas cinco días, son muy reveladores:

En AWS, el precio de alquiler de una A100 (recordemos, un chip de 2020) subió un 30% en un mes.

Del 20 de enero al 19 de febrero.

El H100 subió un 8%.

En Lambda Labs, tanto el A100 como el H100 subieron un 15%.

El A100 tiene seis años.

Hay miles de ellos en el mercado.

Y aun así su precio de alquiler sube un 30% en un mes.

Eso solo ocurre cuando la demanda está absorbiendo toda la oferta disponible, incluyendo hardware antiguo que en condiciones normales debería estar abaratándose.

Pero si yo se esto y ahora tú también, el mercado ya lo sabe y lo refleja en el precio de la acción.

Cuando NVIDIA reporte sus cifras mañana, el mercado ya sabe que van a ser buenas.

¿Quién compra las GPUs y por qué?

Aquí es donde la historia de NVIDIA se conecta con algo que ya analizamos la semana pasada en profundidad.

Si leíste Los riesgos de 2026: mi tesis bajista, ya tienes el contexto completo. Pero lo resumo para quien no lo haya leído.

Las cuatro grandes tecnológicas (Amazon, Alphabet, Meta y Microsoft) han anunciado planes de inversión en infraestructura para 2026 que suman aproximadamente $650.000 millones. Un 67% más que en 2025, que ya fue un año récord. Amazon sola va a gastar $200.000 millones, más que los 21 mayores grupos industriales tradicionales de Estados Unidos juntos.

¿Y en qué se gasta ese dinero?

En centros de datos.

Y los centros de datos necesitan GPUs.

Las GPUs de NVIDIA.

Para NVIDIA esto es una buena noticia en términos de demanda de sus productos. Pero para el inversor que mira el precio de la acción de NVIDIA, hay que tener en cuenta que el entorno general de liquidez del mercado es menos generoso de lo que era. Las correcciones pueden ser más profundas sin ese soporte estructural de las recompras debajo.

Dicho de otra forma: la demanda de GPUs es brutal y real.

Pero eso no garantiza que el precio de NVDA suba, porque el mercado opera con una lógica propia que va más allá de los fundamentales de una empresa concreta.

¿Y el CAPEX de NVIDIA?

Recuerda lo que explicamos la semana pasada: Meta y Google están recortando sus buybacks porque todo el capital se va al CapEx en infraestructura. Están pasando de devolver ~$87.000 millones al año a apenas $25.000 millones estimados para 2026.

NVIDIA no tiene ese problema, y la razón es estructural: NVIDIA es fabless.

No construye fábricas,

no levanta centros de datos,

no tiende cables.

La fabricación la hace TSMC en Taiwán. Su CapEx es mínimo comparado con su competencia. Cada dólar que entra en revenue se convierte en free cash flow a un ritmo que casi ninguna empresa industrial del mundo puede igualar: márgenes brutos del 75%.

El resultado es que NVIDIA está en la posición exactamente opuesta a Meta o Google: genera tanto cash y tiene tan poco donde reinvertirlo en activos físicos que puede mantener un programa de recompras masivo al mismo tiempo que crece al 60% anual.

Es el modelo de negocio ideal: cobra por cada GPU que el mundo necesita para construir la infraestructura de IA, sin tener que construir esa infraestructura ella misma.

El guidance: lo único que importa

Ya lo hemos dicho antes pero vale la pena explicarlo con más detalle, porque es el concepto que más confunde a los inversores.

El mercado solo opera sobre el futuro descontado.

El pasado no importa.

El presente tampoco.

Cuando NVIDIA publique que ha ganado X miles de millones en el trimestre cerrado en enero, eso ya está en el precio. El mercado lleva semanas modelando ese número. Los analistas han ajustado sus estimaciones con los datos del mercado de alquiler, con los anuncios de CapEx de los hyperscalers, con los comentarios de Jensen en conferencias. El resultado del trimestre pasado es historia.

Nota: la nomenclatura de NVIDIA es confusa.

NVIDIA usa su propio año fiscal que termina en enero, por eso hay un desfase:

Lo que reportan esta semana es el Q4 FY2026: el trimestre que cerró el 25 de enero de 2026.

El guidance que darán es para el Q1 FY2027: que en el calendario normal es febrero-abril de 2026.

El consenso de analistas espera que NVIDIA guíe hacia aproximadamente $71.000-71.500 millones de revenue para el Q1 FY2027, el trimestre que termina en abril.

¿Y qué pasa con China?

Aquí hay un problema: las GPUs más avanzadas de NVIDIA sirven para entrenar modelos de IA civiles pero también tienen aplicaciones militares obvias.

El gobierno americano lleva años restringiendo la exportación de chips avanzados a China por razones de seguridad nacional.

En diciembre de 2025 Trump anunció que permitiría a NVIDIA vender chips H200 a China. El 14 de enero de 2026 se formalizó con condiciones:

el gobierno americano se lleva un 25% de los ingresos,

China no puede recibir más del 50% del volumen total de H200 vendidos en EEUU, y

no pueden usarse para fines militares.

Jensen Huang llevaba meses presionando en la Casa Blanca para conseguirlo. Pero en la práctica no queda claro que los chips no estén llegando a China porque hay dos problemas simultáneos:

Por el lado americano, el Departamento de Estado está haciendo su propia revisión de seguridad nacional y poniendo trabas adicionales, lo que tiene los permisos individuales en el limbo.

Por el lado chino, las aduanas de Hong Kong interceptaron los primeros envíos. El gobierno chino necesita los chips pero no quiere aparecer como dependiente de tecnología americana que podría usarse como palanca en futuras negociaciones.

ByteDance, Alibaba, Tencent y DeepSeek han recibido aprobaciones condicionales para unas 400.000 unidades, pero con condiciones que todavía está revisando la comisión económica china.

Jensen estima que el mercado chino podría valer $50.000 millones anuales para NVIDIA. Y cualquier H200 que venda en China sería adicional a su forecast actual de $500.000 millones en Blackwell y Rubin, porque el guidance actual asume cero ventas en China.

Así que el escenario alcista extremo para esta semana sería: buenos resultados + guidance fuerte para el próximo trimestre + señales de que los H200 empiezan a fluir hacia China. Ese combo sería el catalizador para romper los $195 de forma convincente.

Conclusión

La conclusión operativa es esta:

NVIDIA es probablemente la empresa mejor posicionada del mundo en el ciclo tecnológico más importante de las últimas décadas.

Sus fundamentales son extraordinarios.

Su moat es real.

Su modelo de negocio, fabless con márgenes del 75% y sin necesidad de construir nada físico, es casi perfecto.

Y aun así, el gráfico lleva meses dibujando un rango entre 173 y 196 sin poder salir de él.

Porque el mercado ya sabe todo lo anterior. El precio de una acción no refleja lo buena que es una empresa. Refleja lo buena que es en relación a lo que el mercado ya espera de ella. Y cuando las expectativas son tan altas, hasta los resultados extraordinarios pueden decepcionar.

Pero NVIDIA no está exenta de riesgos.

Google lleva años desarrollando sus propias TPUs para no depender de ella.

Meta, Amazon y Microsoft están haciendo lo mismo con sus chips internos.

Y la pregunta de si la IA va a necesitar menos GPUs a medida que madure es una que el mercado se hace en silencio.

De eso hablaremos en el próximo artículo.

Gracias por leer. Si te ha sido útil, compártelo o respóndeme con dudas/sugerencias.

Disclaimer: Todo el contenido tiene fines educativos y refleja mi análisis personal del mercado. No constituye asesoramiento financiero ni recomendación de inversión.